IA y vishing: cuando tu voz se convierte en una amenaza

Las ciberamenazas no dejan de evolucionar, adaptándose a las nuevas tecnologías para atacar a sus víctimas con una eficacia temible. Entre estas amenazas, el vishing, o phishing vocal, destaca por su capacidad para manipular a las personas a través de la voz.

Aunque esta técnica existe desde hace muchos años, el uso de la inteligencia artificial (IA) en estos ataques cambia profundamente las reglas del juego, haciendo que los fraudes sean más convincentes y difíciles de detectar.

La aparición de la IA permite a los ciberdelincuentes automatizar las llamadas, explotar datos personales para crear escenarios personalizados y también suplantar voces de forma muy realista.

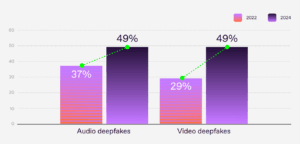

Según un estudio publicado por Regula, el 49 % de las empresas mundiales se enfrentaron a casos de suplantación de identidad mediante deepfakes de audio en 2024, frente a solo el 37 % en 2022.

Porcentaje de empresas que detectaron deepfakes de audio y vídeo en 2022 y 2024. Fuente: Regula.

Los avances tecnológicos y los vínculos cada vez mayores entre la IA y el vishing no hacen más que amplificar el impacto de los ataques de phishing vocal, que se dirigen tanto a particulares como a empresas, administraciones o incluso asociaciones.

IA y vishing, deepfake y deepvoice: panorama general y definiciones

Deepfake: la IA al servicio del fraude

Un deepfake, contracción de «Deep Learning» y «Fake», es una tecnología que utiliza la inteligencia artificial para crear o modificar contenidos visuales, de audio o de vídeo, imitando de forma realista rostros, voces o gestos.

Permite superponer un rostro o una voz sobre otro soporte para simular situaciones que nunca han ocurrido.

Los deepfakes de audio a veces se denominan deepvoices. Esta tecnología se centra específicamente en la síntesis y la imitación de la voz humana. Gracias a los modelos de aprendizaje profundo, los sistemas deepvoice pueden analizar muestras de voz para clonarla de forma extremadamente convincente.

Estas técnicas ofrecen oportunidades, especialmente en el ámbito musical o médico. Sin embargo, también plantean cuestiones éticas y de seguridad, en particular en lo que respecta a la ciberseguridad y, más concretamente, al phishing vocal (vishing).

¿En qué consiste el vishing?

El vishing (también conocido como «voice phishing» o phishing vocal) es una forma de fraude telefónico en la que los ciberdelincuentes se hacen pasar por interlocutores de confianza para obtener información confidencial.

A diferencia del phishing por correo electrónico, el vishing se basa en llamadas de voz. Pero en ambos casos se trata de utilizar métodos de ingeniería social para engañar a las víctimas aprovechando sus emociones (miedo, confianza, sensación de urgencia, etc.).

Los atacantes suelen hacerse pasar por representantes de empresas conocidas, bancos o incluso administraciones para bajar la guardia de su objetivo.

El objetivo de los vishers (ciberdelincuentes que practican el vishing) es incitar a la víctima a revelar datos confidenciales. Estos pueden ser identificadores, contraseñas, información bancaria o acceso a sistemas internos.

Esta forma de ciberdelincuencia es especialmente temible, ya que presenta una tasa de éxito alarmante. Esto es aún más cierto cuando se combinan la IA y el vishing mediante el uso de deepvoice.

Más información sobre el vishing

¿Cómo funciona Deepvoice?

Desde hace algunos años, se ha asistido al desarrollo de programas informáticos que utilizan tecnologías de síntesis de voz. Estos permiten generar voces realistas gracias a la inteligencia artificial.

Estas plataformas ofrecen herramientas para crear voces personalizadas, imitar voces existentes o generar narraciones dinámicas en varios idiomas. Se utilizan, entre otras cosas, en la producción de contenidos, la educación, el entretenimiento, las soluciones de accesibilidad, etc.

Aunque estas empresas prohíben teóricamente el uso fraudulento de sus herramientas, en realidad existen pocas medidas de protección.

Según una investigación realizada por McAfee, basta con grabar la voz durante 3 o 4 segundos para poder clonarla utilizando herramientas disponibles en Internet.

Incluso con herramientas gratuitas, los investigadores pudieron reproducir una voz con un 85 % de fidelidad respecto al original. Con herramientas más sofisticadas y más material de partida, el índice de fidelidad asciende al 95 %.

El acceso a las deepvoices se ha vuelto muy sencillo y ya no requiere conocimientos técnicos especiales. Según Recorded Future, algunos ciberdelincuentes incluso ofrecen sus propios servicios de clonación de voz a cambio de dinero.

IA y vishing: Ábrete, Sésamo

Deepvoice para facilitar el acceso inicial

Para comprometer un sistema mediante un ataque de vishing, un ciberdelincuente necesita un acceso inicial. Por lo general, esto se consigue mediante una llamada directa del pirata informático a su víctima. A veces, la víctima recibe un correo electrónico en el que se le pide que devuelva la llamada al delincuente, con el pretexto, por ejemplo, de resolver un problema técnico.

En todos los casos, el visher desempeña un papel y usurpa la identidad de una persona que inspirará confianza a la víctima (asesor bancario, técnico informático, miembro de la administración, etc.).

El uso de una voz profunda facilita el acceso inicial. El hecho de poder suplantar no solo un rol, sino también una voz asociada a ese rol, facilita enormemente ganarse la confianza de la víctima.

Más aún cuando el ataque utiliza al mismo tiempo el spoofing, una técnica relativamente fácil de implementar que permite al hacker suplantar un número de teléfono.

Al hacerse pasar por un superior, un compañero de trabajo o incluso un asesor bancario personal, el visher no tiene que convencer a su interlocutor de quién es. Reconoce directamente una voz familiar.

Esto incita más fácilmente al objetivo a realizar una operación financiera, conceder acceso remoto al sistema informático o transmitir datos confidenciales.

Movimiento lateral y escalada de privilegios

En el contexto del vishing, un atacante puede utilizar dos técnicas para lograr sus objetivos: el movimiento lateral y la escalada de privilegios.

El movimiento lateral consiste en que un atacante se desplace dentro de un sistema comprometido hacia otros recursos internos. Esto le permite ampliar su acceso y dirigirse a datos o sistemas críticos.

La escalada de privilegios permite obtener derechos superiores. El visher puede entonces acceder a datos sensibles o modificar parámetros a los que no tenía acceso inicialmente.

Sin embargo, un ataque que combina IA y vishing facilita la intrusión profunda en los sistemas informáticos.

En concreto, suele ser más fácil engañar a un empleado dedicado a la centralita telefónica que a un administrador de redes informáticas. Este último está más sensibilizado con las técnicas de los ciberdelincuentes.

Así, un visher puede grabar directamente la voz de un interlocutor o recuperar grabaciones que encuentra en la red tras un acceso inicial.

A continuación, podrá entrenar un modelo deepvoice, lo que le permitirá entablar interacciones creíbles con otros objetivos dentro de la organización. De este modo, obtendrá acceso a sistemas y datos cada vez más sensibles.

¿Dónde encuentran los vishers sus fuentes de información?

La evolución de las técnicas de comunicación facilita el trabajo de los vishers, ya que les permite obtener muestras de voz sin tener que infiltrarse previamente en una red.

De hecho, cada vez más personas graban su voz en Internet. Esto puede hacerse a través de vídeos publicados en las redes sociales o mediante mensajes de voz intercambiados en aplicaciones de mensajería.

Según el estudio de McAfee mencionado anteriormente, el 55 % de los franceses graba su voz al menos una vez a la semana. Parte de estas grabaciones son públicas y otra parte podría llegar a serlo como consecuencia de una filtración de datos.

En lo que respecta a los directivos de empresas, las conferencias grabadas o las entrevistas pueden servir de fuente para personas malintencionadas. La grabación de su voz en el buzón de voz para invitar a dejar un mensaje puede ser, sencillamente, otra fuente.

Con el desarrollo de la IA, este recurso puede permitir a los hackers suplantar muy fácilmente la voz de una persona para llevar a cabo un ataque directamente al más alto nivel.

La combinación de IA y vishing: una amenaza presente y futura

Cuando la realidad alcanza a la ciencia ficción

Según el estudio de McAfee, el 11 % de los franceses ya se ha enfrentado directamente a un intento de vishing mediante suplantación de voz, y el 16 % conoce a alguien a quien le ha ocurrido.

Sin embargo, a escala mundial, el 36 % de los adultos encuestados afirma no haber oído hablar nunca de este riesgo. Por lo tanto, la amenaza es muy grave y, al mismo tiempo, se subestima.

Por otra parte, según el estudio de Regula citado en la introducción, más del 85 % de las empresas consideran que la suplantación de identidad mediante deepfakes de audio o vídeo es una amenaza a tener en cuenta.

El informe también indica que las empresas están más preocupadas por los efectos negativos sobre su reputación que por las pérdidas financieras relacionadas con los ataques. Esto probablemente explica la discreción de las empresas afectadas y el hecho de que este tema no haya recibido más atención mediática por el momento.

Varios casos de empresas víctimas

Son numerosos los casos de particulares víctimas de estafas que utilizan IA y vishing, especialmente en Estados Unidos. La Comisión Federal de Comercio incluso señala el vishing como el ataque más peligroso en términos de pérdidas financieras medias.

En lo que respecta a las empresas, los ejemplos son más difíciles de encontrar, debido principalmente a su falta de comunicación en caso de ataque. Sin embargo, en los últimos años se han hecho públicos algunos casos.

En 2019, el director de una empresa energética británica fue víctima de un ataque de vishing y transfirió 220 000 € a una cuenta fraudulenta tras recibir una supuesta llamada telefónica de su director general, ubicado en Alemania. El atacante utilizó una voz profunda para imitar a la perfección la voz y el acento alemán de la persona suplantada.

Peor aún, a principios de 2024, un empleado de una multinacional cayó en una trampa mediante una videoconferencia falsa en la que todos los participantes eran deepfakes animados. Resultado: el empleado engañado transfirió 25 millones de dólares de buena fe.

Ya se había denunciado un caso similar en 2020, en el que se robaron 35 millones de dólares a una empresa japonesa.

Estos ejemplos ilustran claramente el potencial de los ataques que combinan IA y vishing. Además, hay que tener en cuenta que lo peor probablemente está por llegar y que ninguna empresa puede considerarse a salvo.

Ataques ya peligrosos a pesar de las limitaciones técnicas

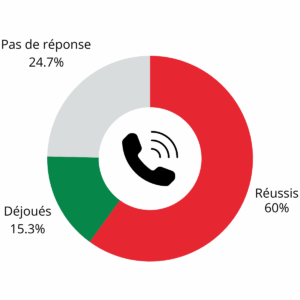

Un estudio realizado en 2024 porla Escuela Politécnica de Quito simuló una campaña de vishing basada en software de clonación de voz de uso general.

Los resultados son alarmantes, ya que, de media, el 60 % de las personas llamadas transmitieron información confidencial a su interlocutor. Solo el 15 % de los objetivos frustraron el ataque.

Resultados de las pruebas de vishing realizadas por la Escuela Politécnica Nacional de Quito en 150 llamadas en un entorno universitario.

No obstante, los distintos estudios citados ponen de relieve las limitaciones de las tecnologías de deepvoice. Por ejemplo, los modelos de IA tienen dificultades para pronunciar correctamente palabras complicadas o imitar voces o expresiones que se salen de lo habitual.

Sin embargo, es probable que estos límites se superen pronto y que los avances permitan ataques aún más sofisticados.

Deepvoice en directo: ¿una futura amenaza?

El uso de la clonación de voz en tiempo real es una evolución preocupante que hay que tener en cuenta. Permitirá a los piratas interactuar directamente con su objetivo.

Actualmente, los vishers crean registros antes de sus ataques. Luego los difunden una vez que están en línea con su víctima. Si esta última se sale del guion previsto, es muy probable que el ataque fracase.

Para contrarrestar esta limitación, los hackers trabajan en el escenario para anticipar las preguntas que podrían plantearse sus objetivos. De este modo, evitan al máximo las interacciones, tal y como explica un especialista en una conferencia disponible en línea.

Sin embargo, un periódico francés ha publicado recientemente el inquietante testimonio de un ataque en el que el visher utilizó una voz profunda en directo. Un hijo que creía estar hablando por teléfono con su madre pudo evitar la trampa al percibir incoherencias en las respuestas de su supuesta madre. Se trata del primer caso declarado en Francia, según Cybermalveillance.gouv.fr.

Por lo tanto, sabemos que es solo cuestión de tiempo antes de que la IA permita utilizar llamadas e incluso vídeos en directo de forma suficientemente convincente.

¿Cómo protegerse contra los ataques que combinan IA y vishing?

Los buenos reflejos y los procedimientos que hay que poner en práctica

Luchar contra los vishers no es tarea fácil, ya que la tecnología evoluciona constantemente y los piratas informáticos siempre van un paso por delante. No obstante, existen algunos procedimientos y soluciones técnicas para protegerse de los ataques que combinan IA y vishing.

1. Implementar la autenticación multifactorial (MFA) para acceder a información crítica o realizar transacciones bancarias.

2. Establecer procedimientos de verificación para confirmar la identidad de una persona antes de responder a solicitudes sensibles por teléfono (llamada de retorno a un número verificado, contraseña de voz, reconocimiento de huellas vocales, etc.).

3. Utilizar exclusivamente chats empresariales seguros para cualquier conversación sensible y no conceder ninguna excepción a este procedimiento.

4. Utilizar tecnologías de autenticación y bloqueo de llamadas para filtrar las llamadas entrantes.

5. Haga preguntas específicas al interlocutor que solo alguien que realmente le conozca pueda responder.

6. Estar atento a las incoherencias en el discurso del interlocutor (pausas inusuales, cambios en los ruidos de fondo, cambios de tono, etc.).

7. Evite comunicar información si el interlocutor le suscita la más mínima duda.

8. Informar de las llamadas sospechosas al servicio de seguridad informática y a sus compañeros para evitar que otras personas caigan en la trampa.

Estas medidas de protección permiten reducir el riesgo de caer en la trampa del vishing. Sin embargo, la lista presentada no es exhaustiva y las tecnologías de defensa evolucionan constantemente, al igual que las tecnologías de ataque. Frente a esta carrera hacia adelante, la mejor solución sigue siendo sensibilizar y poner a prueba a los usuarios.

Sensibilizar y probar con una simulación de vishing

El mejor arma de los vishers es la ignorancia de sus víctimas. Una persona sensibilizada tiene muchas más posibilidades de evitar caer en una trampa.

La sensibilización y la comunicación con familiares y compañeros de trabajo permite reforzar su vigilancia frente a los intentos de manipulación.

Este enfoque permite instaurar una cultura de ciberseguridad en las organizaciones, en la que cada persona se convierte en un eslabón activo en la protección de los sistemas y los datos sensibles.

No obstante, para evaluar el nivel de riesgo de una organización frente al vishing, lo mejor es optar por una puesta en situación (simulación de vishing) para poner a prueba, en condiciones reales, los reflejos de los empleados. Esto permite luego ajustar los procedimientos teniendo en cuenta las recomendaciones derivadas de la simulación.

Conclusión

La inteligencia artificial está transformando el panorama de las ciberamenazas, y el vishing es un ejemplo claro de ello. Para los particulares, las empresas, las asociaciones y los organismos públicos, «vigilancia» y «prevención» deben convertirse en palabras clave.

Invertir en sensibilización y simulaciones de vishing, adoptar soluciones tecnológicas adecuadas y reforzar los procedimientos internos son medidas que permiten protegerse.

La lucha contra las crecientes amenazas que combinan la IA y el vishing exige una movilización colectiva y una adaptación constante a las nuevas realidades tecnológicas.

Estos riesgos, aunque en ocasiones aún se encuentran en una fase embrionaria, requieren una mayor vigilancia y medidas proactivas para anticipar y contrarrestar su posible evolución.

Preguntas frecuentes: IA y vishing

1. ¿Qué es el vishing?

El vishing es una forma de fraude telefónico en la que los ciberdelincuentes se hacen pasar por interlocutores de confianza. Su objetivo es manipular a las víctimas para obtener información confidencial o acceso a sistemas. A diferencia del phishing clásico (por correo electrónico), se basa en llamadas de voz.

2. ¿Qué es Deepvoice?

Deepvoice utiliza la inteligencia artificial para clonar voces humanas de forma realista. Tras analizar unos segundos de una muestra de voz, el software puede crear voces sintéticas muy similares a las originales. Los ciberdelincuentes pueden así imitar a familiares, compañeros de trabajo o directivos de empresas para reforzar la credibilidad de sus ataques.

3. ¿Cómo recopilan los ciberdelincuentes las muestras de voz?

Las muestras de voz suelen obtenerse a través de:

- Las redes sociales (vídeos o audios públicos).

- Grabaciones profesionales (conferencias, entrevistas).

- Las fugas de datos procedentes de diversas plataformas.

- Grabaciones capturadas o robadas tras un acceso inicial al sistema.

4. ¿Es el vishing una amenaza creciente?

Sí. Con los avances en inteligencia artificial, los ataques de vishing son cada vez más sofisticados y difíciles de detectar. La vigilancia y la prevención son fundamentales para contrarrestar esta amenaza en pleno crecimiento.

5. ¿Cuáles son los riesgos para las empresas frente al vishing?

Las empresas están expuestas a varios riesgos, entre ellos:

- Divulgación de datos sensibles, como la información transmitida por los clientes.

- Compromiso del sistema informático con borrado o cifrado de datos.

- Pérdidas financieras relacionadas con transferencias fraudulentas.

- Daño a la reputación de la organización.

6. ¿Cuáles son las medidas adecuadas para evitar sufrir un ataque de vishing?

- Compruebe siempre la identidad de su interlocutor antes de facilitar información confidencial.

- No responda a solicitudes urgentes sin verificarlas dos veces.

- Desconfíe de las incoherencias en el discurso o el comportamiento de su interlocutor.

- Denuncie cualquier llamada sospechosa a su servicio de seguridad o a las autoridades competentes.

7. ¿Cómo protegerse contra los ataques que combinan IA y vishing?

A continuación se indican algunas medidas para reducir los riesgos:

- Implementar la autenticación multifactorial (MFA).

- Utilizar procedimientos estrictos de verificación de identidad.

- Limitar la publicación de muestras de voz en plataformas públicas.

- Utilizar herramientas para bloquear y detectar llamadas sospechosas.

- Sensibilizar a los empleados sobre los riesgos del vishing.

- Prueba las defensas con una simulación de vishing.

8. ¿Qué es una simulación de vishing?

Una simulación de vishing es una situación controlada cuyo objetivo es poner a prueba la capacidad de una organización para reconocer y contrarrestar los ataques de vishing. Permite identificar vulnerabilidades, sensibilizar a los empleados y mejorar los procedimientos de seguridad.

9.¿AvantdeCliquer ofrece simulaciones de vishing?

Sí, el equipo deAvantdeCliquer es experto en la sensibilización sobre todas las formas de ataques de ingeniería social desde 2017. Podemos ayudarle a poner a prueba la resistencia de su organización y de sus empleados ante un ataque de vishing. Póngase en contacto con nosotros para obtener más información.