IA e vishing: quando la tua voce diventa una minaccia

Le minacce informatiche sono in continua evoluzione e si adattano alle nuove tecnologie per colpire le loro vittime con una precisione impressionante. Tra queste minacce, il vishing, o phishing vocale, si distingue per la sua capacità di manipolare le persone attraverso la voce.

Sebbene questa tecnica esista da molti anni, l'uso dell'intelligenza artificiale (IA) in questi attacchi cambia radicalmente la situazione, rendendo le frodi più convincenti e più difficili da individuare.

L'avvento dell'intelligenza artificiale consente ai criminali informatici di automatizzare le chiamate, di sfruttare i dati personali per creare scenari su misura, ma anche di imitare le voci in modo molto realistico.

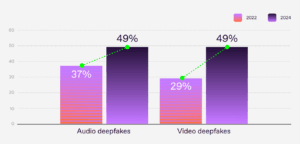

Secondo uno studio pubblicato da Regula, nel 2024 il 49% delle aziende a livello mondiale ha dovuto affrontare casi di furto d'identità tramite deepfake audio, contro solo il 37% nel 2022.

La percentuale di aziende che hanno individuato deepfake audio e video nel 2022 e nel 2024. Fonte: Regula

I progressi tecnologici e i legami sempre più stretti tra l'intelligenza artificiale e il vishing non fanno che amplificare l'impatto degli attacchi di phishing vocale, che prendono di mira sia i privati che le aziende, le amministrazioni pubbliche e persino le associazioni.

IA, vishing, deepfake e deepvoice: panoramica e definizioni

Deepfake: l'intelligenza artificiale al servizio delle frodi

Un deepfake, termine derivato dalla fusione di «Deep Learning» e «Fake», è una tecnologia che utilizza l'intelligenza artificiale per creare o modificare contenuti visivi, audio o video, imitando in modo realistico volti, voci o gesti.

Consente di sovrapporre un volto o una voce a un altro supporto per simulare situazioni che non si sono mai verificate.

I deepfake audio sono talvolta chiamati deepvoice. Questa tecnologia si concentra specificamente sulla sintesi e l'imitazione della voce umana. Grazie a modelli di apprendimento profondo, i sistemi deepvoice sono in grado di analizzare campioni vocali per clonarla in modo estremamente convincente.

Queste tecniche offrono nuove opportunità, in particolare nel settore musicale o medico. Tuttavia, sollevano anche questioni etiche e di sicurezza, soprattutto in materia di sicurezza informatica e, in particolare, di phishing vocale (vishing).

In cosa consiste il vishing?

Il vishing (noto anche come «voice phishing» o phishing vocale) è una forma di frode telefonica in cui i criminali informatici si fingono interlocutori di fiducia per ottenere informazioni sensibili.

A differenza del phishing via e-mail, il vishing si basa sulle chiamate vocali. In entrambi i casi, però, si ricorre a tecniche di ingegneria sociale per ingannare le vittime sfruttando le loro emozioni (paura, fiducia, senso di urgenza, ecc.).

Gli hacker si fingono solitamente rappresentanti di aziende famose, banche o enti pubblici per abbassare la guardia delle loro vittime.

L'obiettivo dei vishers (i criminali informatici che praticano il vishing) è quello di indurre la vittima a rivelare dati riservati. Può trattarsi di credenziali di accesso, password, dati bancari o diritti di accesso a sistemi interni.

Questa forma di criminalità informatica è particolarmente pericolosa perché presenta un tasso di successo allarmante. Ciò è tanto più vero quando l'intelligenza artificiale e il vishing vengono combinati grazie all'uso del deepvoice.

Maggiori informazioni sul vishing

Come funziona DeepVoice?

Da alcuni anni assistiamo allo sviluppo di software che utilizzano tecnologie di sintesi vocale. Questi software consentono di generare voci realistiche grazie all'intelligenza artificiale.

Queste piattaforme offrono strumenti per creare voci personalizzate, imitare voci esistenti o generare narrazioni dinamiche in diverse lingue. Trovano applicazione, in particolare, nella produzione di contenuti, nell’istruzione, nell’intrattenimento, nelle soluzioni per l’accessibilità e in altri ambiti.

Sebbene queste aziende vietino in teoria l'uso fraudolento dei propri strumenti, nella realtà esistono poche misure di sicurezza.

Secondo una ricerca condotta da McAfee, bastano 3 o 4 secondi di registrazione vocale per riuscire a clonarla utilizzando strumenti disponibili su Internet.

Anche utilizzando strumenti gratuiti, i ricercatori sono riusciti a riprodurre una voce fedele all'85% all'originale. Con strumenti più sofisticati e una maggiore quantità di materiale di partenza, il grado di fedeltà sale al 95%.

L'accesso alle deepvoice è quindi diventato molto semplice e non richiede più particolari competenze tecniche. Secondo Recorded Future, alcuni criminali informatici offrono addirittura i propri servizi di clonazione vocale a pagamento.

IA e vishing: Apriti, Sesamo

Deepvoice per facilitare l'accesso iniziale

Per compromettere un sistema tramite un attacco di vishing, un cybercriminale ha bisogno di un accesso iniziale. Ciò avviene in genere tramite una chiamata diretta da parte dell'hacker alla vittima. A volte il bersaglio riceve un'e-mail in cui gli viene chiesto di richiamare lui stesso il criminale, con il pretesto, ad esempio, di risolvere un problema tecnico.

In ogni caso, il visher assume un ruolo e si spaccia per una persona in grado di ispirare fiducia nella vittima (consulente bancario, tecnico informatico, funzionario pubblico, ecc.)

L'uso di una voce sintetica rende più facile il primo contatto. Il fatto di poter assumere non solo un ruolo, ma anche la voce associata a quel ruolo, contribuisce notevolmente a conquistare la fiducia della vittima.

A maggior ragione quando l'attacco ricorre contemporaneamente allo spoofing, una tecnica relativamente semplice da attuare che consente all'hacker di falsificare un numero di telefono.

Fingendosi un superiore, un collega o anche un consulente bancario personale, il truffatore non deve convincere il suo interlocutore di chi sia; questi riconosce immediatamente una voce familiare.

Questo induce più facilmente il destinatario a effettuare un'operazione finanziaria, a concedere l'accesso remoto al sistema informatico o a trasmettere dati sensibili.

Movimento laterale e escalation dei privilegi

Nel contesto del vishing, un aggressore può ricorrere a due tecniche per raggiungere il proprio obiettivo: il movimento laterale e l'escalation dei privilegi.

Il movimento laterale consiste nel fatto che un aggressore si sposti all'interno di un sistema compromesso verso altre risorse interne. Ciò gli consente di ampliare il proprio accesso e di prendere di mira dati o sistemi critici.

L'escalation dei privilegi consente invece di ottenere diritti più elevati. L'autore dell'attacco può così accedere a dati sensibili o modificare impostazioni a cui inizialmente non aveva accesso.

Tuttavia, un attacco che combina l'intelligenza artificiale e il vishing facilita l'intrusione in profondità nei sistemi informatici.

In pratica, di solito è più facile eludere la vigilanza di un operatore del centralino rispetto a quella di un amministratore di rete. Quest'ultimo, infatti, è più consapevole delle tecniche utilizzate dai criminali informatici.

Pertanto, un visher può tranquillamente registrare direttamente la voce di un interlocutore o recuperare registrazioni che trova in rete dopo un primo accesso.

Potrà quindi addestrare un modello DeepVoice, che gli consentirà di intrattenere interazioni credibili con altri destinatari all'interno dell'organizzazione. In questo modo otterrà accesso a sistemi e dati sempre più sensibili.

Da dove traggono le loro fonti di informazione i vishers?

L'evoluzione delle tecniche di comunicazione facilita il lavoro dei vishers, consentendo loro di acquisire campioni vocali senza nemmeno dover prima infiltrarsi in una rete.

Infatti, sempre più persone registrano la propria voce su Internet. Ciò può avvenire tramite video pubblicati sui social network o tramite messaggi vocali scambiati sulle app di messaggistica.

Secondo lo studio di McAfee citato in precedenza, il 55% dei francesi registra la propria voce almeno una volta alla settimana. Una parte di queste registrazioni è di dominio pubblico, mentre l’altra potrebbe benissimo diventarlo a seguito di una fuga di dati.

Per quanto riguarda i dirigenti aziendali, le conferenze registrate o le interviste possono costituire una fonte di informazioni per soggetti malintenzionati. Anche la registrazione della loro voce nella segreteria telefonica, in cui invitano a lasciare un messaggio, può semplicemente rappresentare un’altra fonte.

Con lo sviluppo dell'intelligenza artificiale, questa tecnologia può consentire agli hacker di imitare con estrema facilità la voce di una persona per sferrare un attacco direttamente ai vertici.

Il cocktail di IA e vishing: una minaccia attuale e futura

Quando la realtà supera la fantascienza

Sempre secondo lo studio di McAfee, l'11% dei francesi ha già subito in prima persona un tentativo di vishing tramite imitazione della voce, mentre il 16% conosce qualcuno a cui è successo.

Tuttavia, a livello mondiale, il 36% degli adulti intervistati dichiara di non aver mai sentito parlare di questo rischio. Si tratta quindi di una minaccia molto grave e al tempo stesso sottovalutata.

Inoltre, secondo lo studio di Regula citato nell'introduzione, oltre l'85% delle aziende considera le frodi di identità tramite deepfake audio o video una minaccia da tenere in considerazione.

Il rapporto sottolinea inoltre che le aziende sono più preoccupate per le ripercussioni negative sulla loro reputazione che per le perdite finanziarie legate agli attacchi. Ciò spiega probabilmente la riservatezza delle aziende colpite e il fatto che, per il momento, l'argomento non abbia ricevuto maggiore risalto mediatico.

Diversi casi di aziende vittime

Sono numerosi i casi di privati cittadini vittime di truffe che sfruttano l'intelligenza artificiale e il vishing, in particolare negli Stati Uniti. La Federal Trade Commission indica addirittura il vishing come l'attacco più pericoloso in termini di perdite finanziarie medie.

Per quanto riguarda le aziende, è più difficile trovare esempi, soprattutto a causa della loro scarsa comunicazione in caso di attacco. Tuttavia, negli ultimi anni sono stati resi noti alcuni casi.

Nel 2019, il dirigente di un’azienda energetica britannica è stato vittima di un attacco di vishing, trasferendo 220.000 € su un conto fraudolento dopo aver ricevuto una presunta telefonata dal proprio amministratore delegato, con sede in Germania. L’autore dell’attacco ha utilizzato una tecnologia di deepvoice per imitare alla perfezione la voce e l’accento tedesco della persona di cui si era appropriato l’identità.

Ma c'è di peggio: all'inizio del 2024, un dipendente di una multinazionale è stato vittima di una videoconferenza fasulla in cui tutti i partecipanti erano rappresentati da deepfake. Il risultato: il dipendente ingannato ha trasferito in buona fede 25 milioni di dollari.

Un caso simile era già stato segnalato nel 2020, con un bottino di 35 milioni di dollari sottratti a un'azienda giapponese.

Questi pochi esempi dimostrano chiaramente il potenziale degli attacchi che combinano l'intelligenza artificiale e il vishing. Inoltre, bisogna tenere presente che il peggio deve probabilmente ancora arrivare e che nessuna azienda può considerarsi al sicuro.

Attacchi già pericolosi nonostante i limiti tecnici

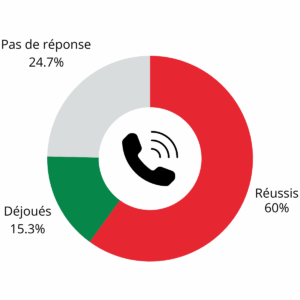

Uno studio condotto nel 2024dall'École polytechnique di Quito ha simulato una campagna di vishing basata su software di clonazione vocale disponibili al grande pubblico.

I risultati sono allarmanti, poiché in media il 60% delle persone contattate ha fornito informazioni sensibili al proprio interlocutore. Solo il 15% dei destinatari è riuscito a sventare l'attacco.

Risultati dei test di vishing condotti dall'École polytechnique nationale di Quito su 150 chiamate in un contesto universitario.

I vari studi citati sottolineano tuttavia i limiti delle tecnologie deepvoice. I modelli di IA, ad esempio, incontrano difficoltà nel pronunciare correttamente parole complesse o nell'imitare voci o espressioni fuori dal comune.

È tuttavia probabile che tali limiti vengano presto superati e che i progressi tecnologici consentano attacchi ancora più sofisticati.

Deepvoice in diretta: una piaga futura?

L'uso della clonazione vocale in tempo reale è un'evoluzione preoccupante da tenere in considerazione. Consentirà agli hacker di interagire direttamente con il proprio bersaglio.

Attualmente, i visher registrano le conversazioni prima di sferrare i loro attacchi. Poi le riproducono una volta in linea con la vittima. Se quest’ultima si discosta dal copione prestabilito, l’attacco rischia fortemente di fallire.

Per ovviare a questo limite, gli hacker elaborano uno scenario per anticipare le domande che i loro bersagli potrebbero porsi. In questo modo evitano il più possibile le interazioni, come spiega un esperto in una conferenza disponibile online.

Tuttavia, un quotidiano francese ha recentemente riportato la preoccupante testimonianza di un attacco in cui il truffatore ha utilizzato una tecnologia di sintesi vocale in tempo reale. Un figlio, credendo di avere sua madre al telefono, è riuscito a evitare la trappola notando alcune incongruenze nelle risposte della presunta madre. Secondo Cybermalveillance.gouv.fr, si è trattato del primo caso segnalato in Francia.

Sappiamo quindi che è solo questione di tempo prima che l'intelligenza artificiale consenta di utilizzare le chiamate e persino i video in diretta in modo sufficientemente convincente.

Come proteggersi dagli attacchi che combinano l'intelligenza artificiale e il vishing?

I comportamenti corretti e le procedure da adottare

Combattere il vishing non è affatto facile, poiché la tecnologia è in continua evoluzione e gli hacker sono sempre un passo avanti. Esistono comunque alcune procedure e soluzioni tecniche per proteggersi dagli attacchi che combinano l'intelligenza artificiale e il vishing.

1. Attivare l'autenticazione a più fattori (MFA) per accedere alle informazioni critiche o effettuare operazioni bancarie.

2. Adottare procedure di verifica per confermare l'identità di una persona prima di rispondere a richieste sensibili per telefono (richiamata su un numero verificato, password vocale, riconoscimento delle impronte vocali, ecc.).

3. Utilizzare esclusivamente chat aziendali protette per qualsiasi conversazione riservata e non concedere alcuna deroga a questa procedura.

4. Utilizzare tecnologie di autenticazione e blocco delle chiamate per filtrare le chiamate in entrata.

5. Ponete all’interlocutore domande specifiche a cui solo chi vi conosce davvero è in grado di rispondere.

6. Prestare attenzione alle incongruenze nel discorso dell'interlocutore (pause insolite, variazioni nei rumori di sottofondo, cambiamenti di tono, ecc.).

7. Evitare di fornire informazioni se l'interlocutore suscita il minimo dubbio.

8. Segnalare le chiamate sospette al servizio di sicurezza informatica e ai colleghi per evitare che qualcun altro cada nella trappola.

Queste misure di protezione consentono di ridurre il rischio di cadere nella trappola del vishing. Tuttavia, l'elenco presentato non è esaustivo e le tecnologie di difesa sono in continua evoluzione, proprio come quelle di attacco. Di fronte a questa corsa sfrenata, la soluzione migliore rimane quindi quella di sensibilizzare e mettere alla prova gli utenti.

Sensibilizzare e testare con una simulazione di vishing

L'arma più potente dei truffatori è l'ignoranza delle loro vittime. Una persona informata ha molte più possibilità di sventare una truffa.

La sensibilizzazione e la comunicazione con i propri cari e i colleghi consentono di rafforzare la loro vigilanza nei confronti dei tentativi di manipolazione.

Questo approccio consente di instaurare una cultura della sicurezza informatica all'interno delle organizzazioni, in cui ogni persona diventa un anello attivo nella protezione dei sistemi e dei dati sensibili.

Resta comunque il fatto che, per valutare il livello di rischio di un'organizzazione di fronte al vishing, la soluzione migliore è quella di ricorrere a una simulazione (simulazione di vishing) per mettere alla prova, in condizioni reali, i riflessi dei dipendenti. Ciò consente poi di adeguare le procedure tenendo conto delle raccomandazioni emerse dalla simulazione.

Conclusione

L'intelligenza artificiale sta trasformando il panorama delle minacce informatiche, e il vishing ne è un esempio lampante. Per i privati, le aziende, le associazioni e gli enti pubblici, «vigilanza» e «prevenzione» devono diventare le parole d'ordine.

Investire nella sensibilizzazione e nelle simulazioni di vishing, adottare soluzioni tecnologiche adeguate e rafforzare le procedure interne sono tutte misure efficaci per proteggersi.

La lotta contro le crescenti minacce che combinano l'intelligenza artificiale e il vishing richiede una mobilitazione collettiva e un costante adeguamento alle nuove realtà tecnologiche.

Questi rischi, sebbene talvolta siano ancora in una fase embrionale, richiedono una maggiore vigilanza e misure proattive per anticiparne e contrastarne la potenziale evoluzione.

Domande frequenti: IA e vishing

1. Che cos'è il vishing?

Il vishing è una forma di frode telefonica in cui i criminali informatici si fingono interlocutori di fiducia. Il loro obiettivo è manipolare le vittime per ottenere informazioni sensibili o l'accesso ai sistemi. A differenza del phishing tradizionale (via e-mail), si basa sulle chiamate vocali.

2. Che cos'è il deepvoice?

Deepvoice utilizza l'intelligenza artificiale per clonare voci umane in modo realistico. Analizzando pochi secondi di un campione vocale, il software è in grado di creare voci sintetiche molto simili all'originale. I criminali informatici possono così imitare familiari, colleghi o dirigenti aziendali per aumentare la credibilità dei loro attacchi.

3. In che modo i criminali informatici raccolgono campioni vocali?

I campioni vocali vengono spesso ricavati tramite:

- I social network (video o audio pubblici).

- Registrazioni professionali (conferenze, interviste).

- Le fughe di dati provenienti da varie piattaforme.

- Registrazioni acquisite o sottratte a seguito di un accesso iniziale al sistema.

4. Il vishing rappresenta una minaccia in aumento?

Sì. Con i progressi dell'intelligenza artificiale, gli attacchi di vishing stanno diventando sempre più sofisticati e difficili da individuare. La vigilanza e la prevenzione sono fondamentali per contrastare questa minaccia in rapida espansione.

5. Quali sono i rischi per le aziende legati al vishing?

Le aziende sono esposte a diversi rischi, tra cui:

- Divulgazione di dati sensibili, come le informazioni fornite dai clienti.

- Compromissione del sistema informatico con cancellazione o crittografia dei dati.

- Perdite finanziarie dovute a bonifici fraudolenti.

- Danni alla reputazione dell'organizzazione.

6. Quali sono le precauzioni da adottare per evitare di cadere vittima di un attacco di vishing?

- Verificate sempre l'identità della persona con cui state parlando prima di fornire informazioni riservate.

- Non rispondere alle richieste urgenti senza aver prima verificato.

- Fate attenzione alle incongruenze nel discorso o nel comportamento del vostro interlocutore.

- Segnalate qualsiasi chiamata sospetta al vostro servizio di sicurezza o alle autorità competenti.

7. Come proteggersi dagli attacchi che combinano l'intelligenza artificiale e il vishing?

Ecco alcune misure per ridurre i rischi:

- Implementare l'autenticazione a più fattori (MFA).

- Adottare procedure rigorose di verifica dell'identità.

- Limitare la pubblicazione di campioni vocali su piattaforme pubbliche.

- Utilizzare strumenti per il blocco e l'individuazione delle chiamate sospette.

- Sensibilizzare i dipendenti sui rischi legati al vishing.

- Verificare le misure di sicurezza con una simulazione di vishing.

8. Che cos'è una simulazione di vishing?

Una simulazione di vishing è un'esercitazione controllata volta a verificare la capacità di un'organizzazione di riconoscere e contrastare gli attacchi di vishing. Consente di individuare le vulnerabilità, sensibilizzare i dipendenti e migliorare le procedure di sicurezza.

9.AvantdeCliquer offre simulazioni di vishing?

Sì, il team diAvantdeCliquer è esperta nella sensibilizzazione su tutte le forme di attacchi di social engineering dal 2017. Possiamo aiutarvi a testare la resistenza della vostra organizzazione e dei vostri collaboratori a un attacco di vishing. Contattateci per saperne di più.